[��(l��)�ξW(w��ng)��(d��o)�x]ai�O����ʲô��˼��һҹ֮�g��AI�O���ˡ����ȫ�W(w��ng)���ɴ����l(f��)�˴�Ҍ�(du��)ai���l�D(zhu��n)�Q���ߵ����P(gu��n)̽ӑ��ai�O������ʹ��GitHub�����һ��(g��)�_(k��i)Դ�(xi��ng)ĿSO-VITS-SVC��������(l��i)���Ñ�(h��)�����ڴ��(xi��ng)Ŀ��ͨ�^(gu��)ai���ܹ����ռ��O���˵���ɫ���Ķ�����Ŀ��(bi��o)��ɫģ�́�(l��i)������Ʒ��ai�O������ô���ģ���֪���������s�o��(l��i)������

ai�O����ʲô��˼��һҹ֮�g��AI�O���ˡ����ȫ�W(w��ng)���ɴ����l(f��)�˴�Ҍ�(du��)ai���l�D(zhu��n)�Q���ߵ����P(gu��n)̽ӑ��ai�O������ʹ��GitHub�����һ��(g��)�_(k��i)Դ�(xi��ng)ĿSO-VITS-SVC��������(l��i)���Ñ�(h��)�����ڴ��(xi��ng)Ŀ��ͨ�^(gu��)ai���������ռ��O���˵���ɫ���Ķ�����Ŀ��(bi��o)��ɫģ�́�(l��i)������Ʒ��ai�O������ô���ģ���֪���������s�o��(l��i)������

ai�O����ʲô��˼

һҹ֮�g��AI�O���ˡ����ȫ�W(w��ng)����Bվ�ϣ�AI�O���˷������ֿ��ܡ����f(shu��)�����ܶ�����(��i)����Ԫǰ�����w�ס��ɶ����ȵȣ�һ���W(w��ng)�����ݟo(w��)���Ρ��W(w��ng)�ѱ�ʾ�� (t��ng)��һ����AI�O���ˣ�����ȥ��......

�@Щ������Ʒ����һ��(g��)����so-vits-svc���_(k��i)Դ�(xi��ng)Ŀ���H�{��(sh��)�����l���Ϳ���һ��(g��)����ʽģ�́�(l��i)�ϳ�Ŀ��(bi��o)��ɫ�����l��Ӗ(x��n)�����Ñ�(h��)��Ҫ���W(xu��)ģ�͡��@��(g��)ģ�Ϳ��Ա������ߺ����{(di��o)��Ҳ�����ò�ͬ���Z(y��)����(l��i)������

ai�O�������d�����c(di��n)�����d��

ai�O��������

����һ��

һ����(zh��n)�乤��

Ӗ(x��n)����(sh��)��(j��)���P(gu��n)�I��Խ����|(zh��)�������l��(sh��)��(j��)��Ч��Խ�ã����h���ٜ�(zh��n)��һ��(g��)С�r(sh��)���ϵ����l��

�@�����hʹ�� N �����@�� 8G ���ϡ�

�Ҍ��(xi��ng)Ŀ����Ҫ�Ĵ��a�����������˳���(l��i)��������Ҫ�������u(p��ng)Փ�^(q��)���Ի���ͨ�^(gu��)�·�朽�(li��n)ϵ�ҡ�

��(d��ng)Ȼ��Ҳ����ֱ�����_(k��i)Դ���aֱ�Ӳ��𣬵�ַ����

GitHub - svc-develop-team/so-vits-svc: SoftVC VITS Singing Voice Conversion

�����h(hu��n)�����b

1.���bpytorch��ȌW(xu��)��(x��)���

��Ҫ���bpytorch,torchaudio,torchvision����(g��)��(k��)

������֮ǰ��(xi��)��https://yunlord.blog.csdn.net/article/details/129812705?spm=1001.2014.3001.5502

2.���b���P(gu��n)��ه(l��i)

���Կ������d���(xi��ng)Ŀ�а����ɂ�(g��)requirements.txt����windows������

�M(j��n)�뵽�(xi��ng)Ŀ�У�ͨ�^(gu��)promptݔ������ָ�

pip install -r requirements_win.txt

������(sh��)��(j��)̎��

Ӗ(x��n)�����l��߀����Ҫ�A(y��)�y(c��)�������f(shu��)�D(zhu��n)�Q�����l�����������ĸ����Q��Ԓ(hu��)�f(shu��)���l�в��ܰ��������������ࡢ���ȣ����ԟo(w��)Փ��Ӗ(x��n)�����A(y��)�y(c��)������Ҫ��(du��)��(sh��)��(j��)�M(j��n)��̎����

1.��ȡ��

�҂�����ͨ�^(gu��)UVR5 �@��(g��)ܛ����(sh��)�F(xi��n)�����c�����x��

�� Windows �¿���ֱ��ʹ�á����_(k��i)ܛ����������������

�\(y��n)�м��ɷ��x���Ͱ��ࡣ

Ȼ���ٰ����������ã�ȥ������

��(j��ng)�^(gu��)��ȡ���ĸɃ������l�Ϳ����Á�(l��i)Ӗ(x��n)����

2.����l

���^(gu��)��?y��n)����l̫�L(zh��ng)����Ҫ���^(gu��)��ʮ�룬�����ױ��@�棬��Ҫ��(du��)���l�ļ��M(j��n)����Ƭ��

�҂�ͨ�^(gu��) Audio Slicer�@��(g��)���ߌ�(sh��)�F(xi��n)���l�з� ��

ֱ���\(y��n)�� slicer-gui.exe��

�(xi��)ݔ��·�����(xi��)ݔ��·������������(sh��)��Ĭ�J(r��n)���ɣ��@�Ӿ͕�(hu��)�õ��зֺõ����l�Ρ�

���h����֮����� (t��ng)�£���Ч�����õĄh�������|(zh��)�������l�Ȕ�(sh��)�����Ч�����á��������߀�Еr(sh��)�L(zh��ng)���^(gu��)30s�Ŀ���ͨ�^(gu��)��(xi��)��python���l�и���a�M(j��n)�н��С�

���(xi��ng)Ŀ�� so-vits-svc-4.0/dataset_raw Ŀ���(chu��ng)��һ��(g��)�ļ��A�������ҵ��� wang_processed����̎���õĔ�(sh��)��(j��)�ŵ����档

�ġ�Ӗ(x��n)��ģ��

��Ӗ(x��n)��ģ��ǰ���҂���Ҫ�º�ԭʼģ�ͣ�������ŵ���(du��)��(y��ng)λ��

��checkpoint_best_legacy_500.pt����hubert�ļ��A��

��D_0.pth��G_0.pth����logs/44kĿ���

1.��(sh��)��(j��)�A(y��)̎��

����(l��i)����ֱ���\(y��n)���(xi��ng)Ŀ�����1.��(sh��)��(j��)�A(y��)̎��.bat��

�@��(g��)�_�����ǰ��ղ��E���\(y��n)�и���(g��) py �_��

�زɘ���44100Hz����

python resample.py

�Ԅ�(d��ng)����Ӗ(x��n)�������(y��n)�C�����Ԅ�(d��ng)���������ļ�

python preprocess_flist_config.py

����hubert�cf0

python preprocess_hubert_f0.py

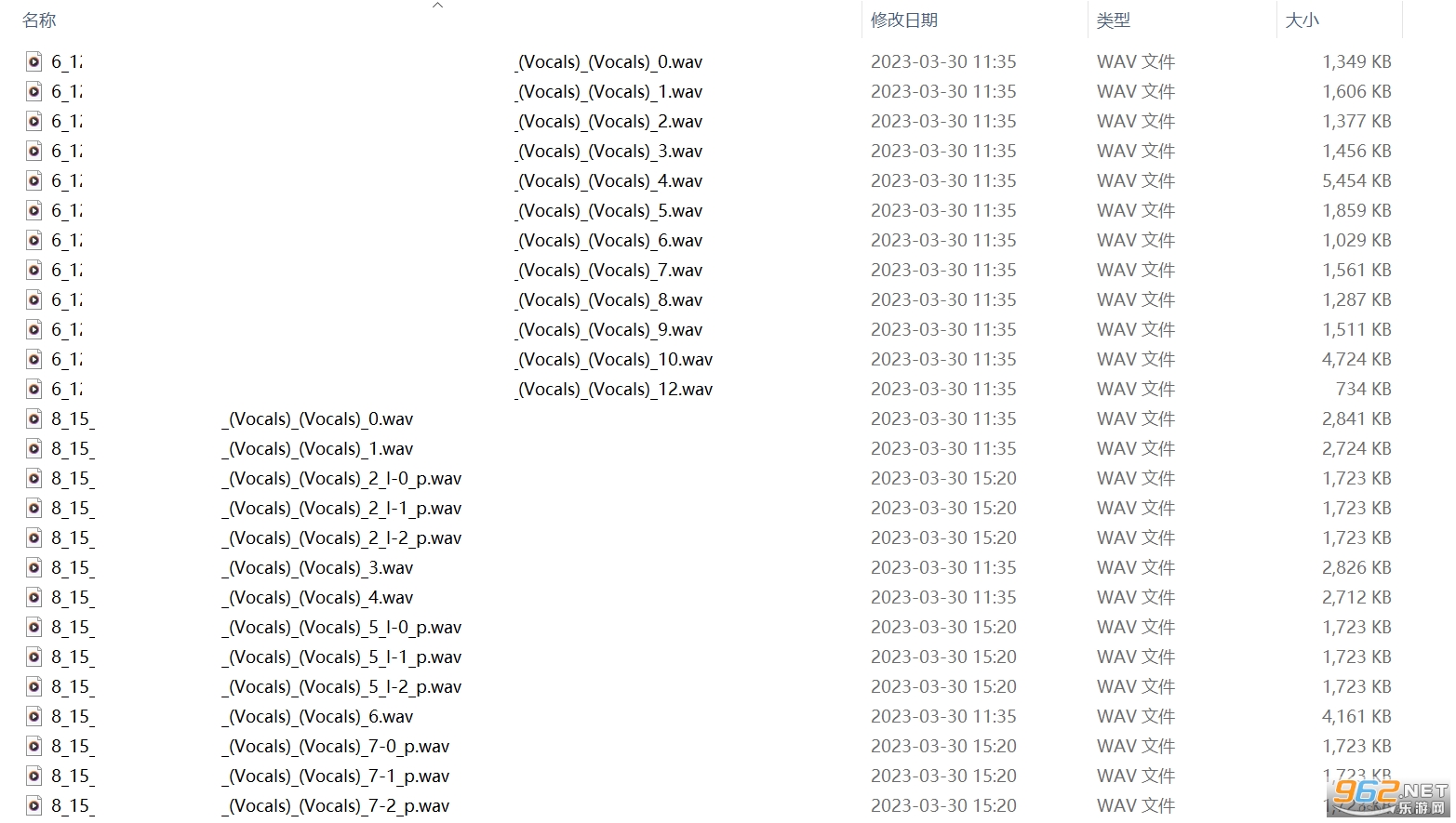

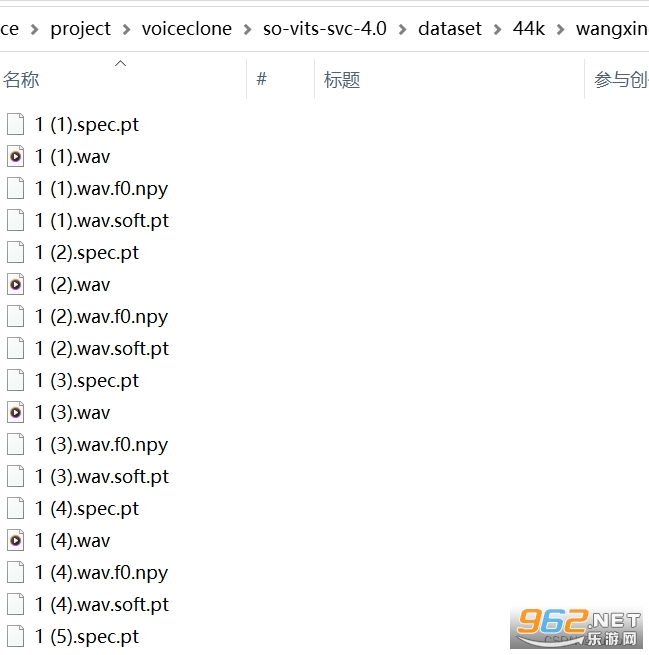

̎���ꮅ���(hu��)�� datset/44k ������һ��(g��)�ļ��A������Ĕ�(sh��)��(j��)���D��ʾ

���Ԅh�� dataset_raw �ļ��A�ˡ�

2.ģ��Ӗ(x��n)��

ֱ���\(y��n)���(xi��ng)Ŀ�е�2.Ӗ(x��n)��.bat�����_(k��i)��Ӗ(x��n)����

python train.py -c configs/config.json -m 44k

����@����ÿ������� batch_size ���Ӗ(x��n)���ٶȌ�(du��)��(y��ng)�������ļ��� configs/config.json �ļ��

�@��(g��)Ӗ(x��n)���r(sh��)�g���L(zh��ng)����(g��)���X(ju��)�������(sh��)��(j��)�^�õ�Ԓ(hu��)��Ӗ(x��n)����30000݆���Ͼ���һ��(g��)���e(cu��)��Ч����

3.���(l��i)ģ��Ӗ(x��n)��

ֱ���\(y��n)���(xi��ng)Ŀ�е�3.Ӗ(x��n)�����(l��i)ģ��.bat�����_(k��i)��Ӗ(x��n)�����@��(g��)���^�죬��犼������ꡣ

�@��(g��)��Ҫ�ǿ��ԜpС��ɫй©��ʹ��ģ��Ӗ(x��n)������(l��i)����Ŀ��(bi��o)����ɫ�����䌍(sh��)�����e���@�����džμ��ľ��(l��i)������(hu��)����ģ�͵�ҧ�֣���(hu��)���X���壬�@��(g��)�����@����ģ�Ͳ������ںϵķ�ʽ�����Ծ��Կ��ƾ��(l��i)�����c�Ǿ��(l��i)������ռ�ȣ�Ҳ���ǿ����ք�(d��ng)����Ŀ��(bi��o)��ɫ��ҧ������֮�g�{(di��o)���������ҵ����m�������c(di��n)��

ʹ�þ��(l��i)ǰ������в��E�����M(j��n)���κε�׃��(d��ng)��ֻ��Ҫ�~��Ӗ(x��n)��һ��(g��)���(l��i)ģ�ͣ��mȻЧ�����^���ޣ���Ӗ(x��n)���ɱ�Ҳ���^�͡�

Ӗ(x��n)���^(gu��)�̣�

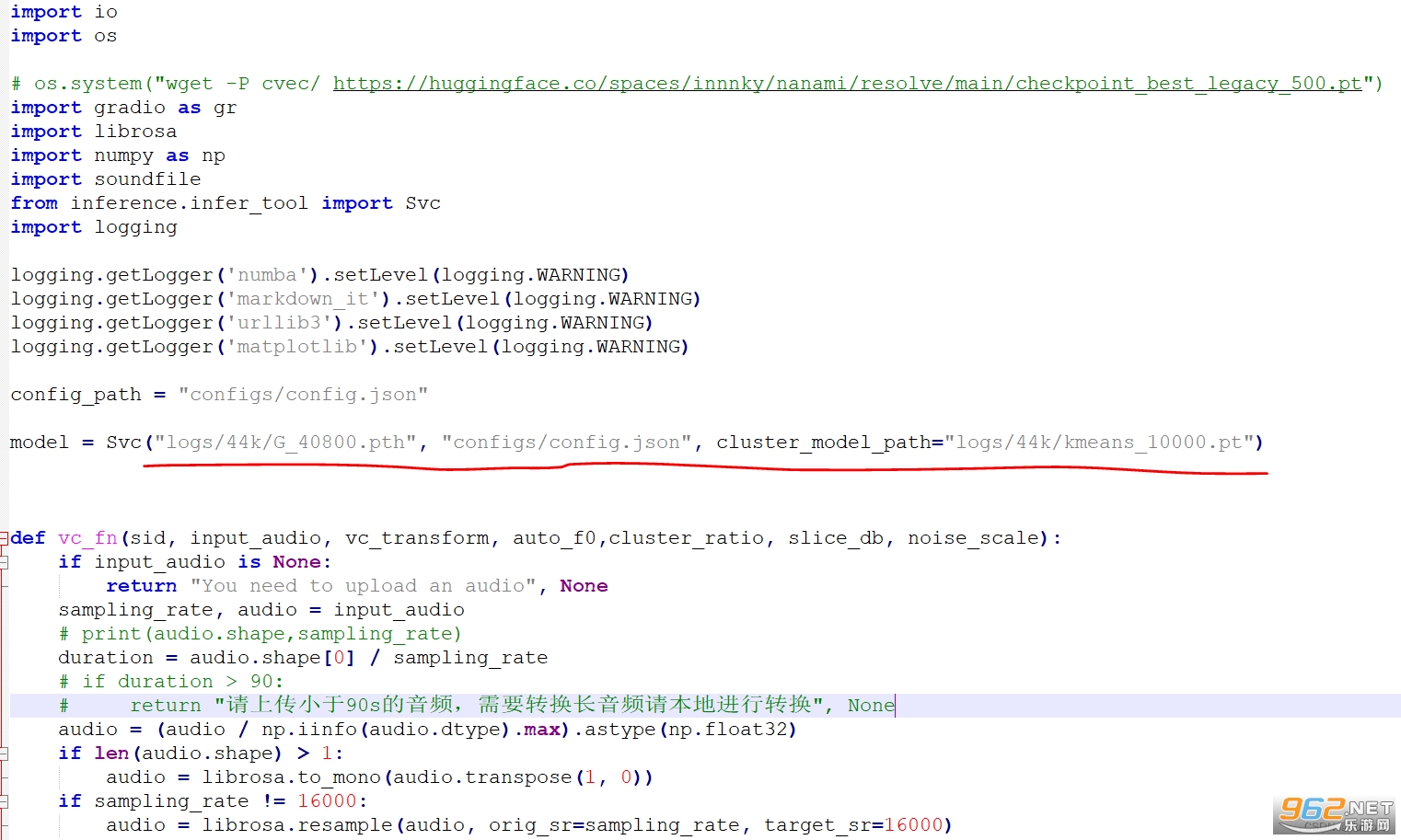

��(zh��)��python cluster/train_cluster.py��ģ�͵�ݔ����(hu��)��logs/44k/kmeans_10000.pt

�����^(gu��)�̣�

inference_main.py��ָ��cluster_model_path

inference_main.py��ָ��cluster_infer_ratio��0����ȫ��ʹ�þ��(l��i)��1��ֻʹ�þ��(l��i)��ͨ���O(sh��)��0.5����

4.�����A(y��)�y(c��)

��(zh��n)���

��(zh��n)��һ��ĸ����������������l�زĜ�(zh��n)���ǘ�̎����ͨ�^(gu��)UVR5��ȡһ�β����^(gu��)90s�ĸ��زġ�

��ģ����

�� app.py ����@һ��

Ӗ(x��n)���õ�ģ�ʹ������ logs/44k Ŀ����@��Ğ�Ӗ(x��n)���õ�ģ�͵�ַ���Լ���(du��)��(y��ng)�������ļ�������ǵ��������ɵ� pt �ļ�·����

�\(y��n)��web

ֱ���\(y��n)���(xi��ng)Ŀ�е�4.�����A(y��)�y(c��).bat��

�����(hu��)ֱ���_(k��i)��һ��(g��) webui�����_(k��i)���� url��ֱ�ӏ�(f��)�Ƶ��g�[����ַ���д��_(k��i)���ɡ�

����һ��(g��)��(ji��n)���� Web �(y��)�棬����ą���(sh��)������ֱ��ʹ��Ĭ�J(r��n)�ģ�����һ��(g��)���l�������D(zhu��n)�Q��ɫ��

��������

���dGitHub app���������½̳��M(j��n)�в���

GitHub���d�����c(di��n)�����d��

github���Ժܷ�����҂����c�_(k��i)Դ�(xi��ng)Ŀ�У���ؕ�I(xi��n)�Լ��Ĵ��a.��ô,�҂�?c��)�ôȥ���cһ��(g��)�_(k��i)Դ��github�(xi��ng)Ŀ�أ�

���ȣ�ȥ�L��(w��n)��Ҫ���c��github���(y��)���c(di��n)����Fork�� => create Fork.

2. Ȼ���@�ӾͰ��@���(xi��ng)Ŀ��ؐ��������h(yu��n)�̂}(c��ng)��(k��)�������Լ����~̖(h��o)��䛲鿴��Ă}(c��ng)��(k��)����(hu��)�l(f��)�F(xi��n)��Ă}(c��ng)��(k��)�ѽ�(j��ng)�����@��(g��)�(xi��ng)Ŀ���c(di��n)��Code,copy���github��ַ��һ��Ҫע�⣬Ҫ���Լ���github�~̖(h��o)���M(j��n)�У���Ҫ���(xi��ng)Ŀ���ߵĂ}(c��ng)��(k��)�ϣ���?y��n)���ľ�Й?qu��n)��,���Dz����M(j��n)�����ͺ��ĵ�.

3.��D,��git����������git clone + copy��github��ַ�т}(c��ng)��(k��)��¡����Ĺ����^(q��)��,

clone��ɺ���Ϳ�������Ĺ����^(q��)�����@��(g��)�(xi��ng)Ŀ�ļ���Ȼ����Ϳ����_(k��i)ʼ�ɻ��ˣ�

�������Ȱ���Ĵ��a�ύ����Ă}(c��ng)��(k��)����:

git add test.md;

gti commit -m something

git push origin���h(yu��n)�̂}(c��ng)��(k��)�� -u master�����ط�֧��

עpush ���� -u ����(sh��) �Ǟ�������h(yu��n)�̂}(c��ng)��(k��)�c��ı��ط�֧�����B�ӣ��Ժ�push�ĕr(sh��)��Ϳ��Բ��ؼ����@��(g��)����(sh��)��.

Ȼ��������~̖(h��o)���M(j��n)�� Pull requestsؕ�I(xi��n)��Ĵ��a��

���ڌ�(du��)���Ƿ������Ĵ��a��Ҫ����(du��)����������

ϲ�g

ϲ�g  �

� �o(w��)��

�o(w��)�� ���^

���^ ��

�� �y�^(gu��)

�y�^(gu��) airasia(com.airasia.mobile)app v12.6.0

�����н�ͨ / 24-05-24

airasia(com.airasia.mobile)app v12.6.0

�����н�ͨ / 24-05-24

��(y��u)Ѳai�ƱO(ji��n)��v1.3.2 �ٷ���

����(sh��)�ù��� / 23-08-03

��(y��u)Ѳai�ƱO(ji��n)��v1.3.2 �ٷ���

����(sh��)�ù��� / 23-08-03

gencraft ai�L��(hu��) v1.1.1

����(sh��)�ù��� / 23-05-08

gencraft ai�L��(hu��) v1.1.1

����(sh��)�ù��� / 23-05-08

늄�(d��ng)��܇(ch��)ģ�M��Electric Trains0.809�汾v0.809 ���°�

�����e���� / 24-05-17

늄�(d��ng)��܇(ch��)ģ�M��Electric Trains0.809�汾v0.809 ���°�

�����e���� / 24-05-17

project sekai�_(t��i)���� v3.6.0

������(l��)�赸 / 24-05-27

project sekai�_(t��i)���� v3.6.0

������(l��)�赸 / 24-05-27

cվ ai�L��(hu��)���b v1.0.2.6

����(sh��)�ù��� / 23-10-23

cվ ai�L��(hu��)���b v1.0.2.6

����(sh��)�ù��� / 23-10-23

��(zhu��n)�I(y��)���Α����d���C���T(m��n)��(h��)�W(w��ng)վ

Copyright 2009-2016 www.i95191.cn ���(qu��n)����

��ICP��17018784̖(h��o)-1

���T(m��n)�u(p��ng)Փ

�����u(p��ng)Փ